Ich finde schon. Sind US-amerikanische Filme wirklich die besten der besten?

Verwandte Themen

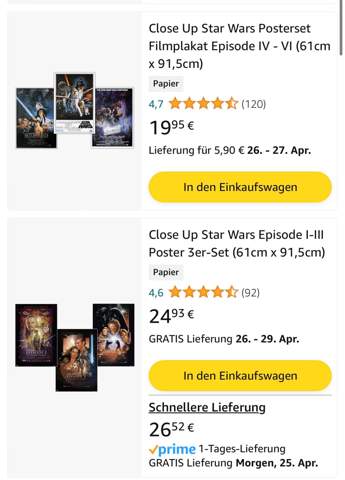

Sind US-amerikanische Filme die besten Filme?

Schauspieler,

Fernsehen,

Film,

Kino,

Geld,

Menschen,

USA,

Streaming,

Thriller,

Filmindustrie,

Hollywood,

Netflix,

Disney Plus